Az adatközpontok világában ritkán hangzanak el valódi korszakhatárt jelző mondatok. Amikor azonban az Amazon Web Services és a Siemens vezetői már arról beszélnek, hogy az AI-infrastruktúra „az elektrifikáció óta a legnagyobb mérnöki kihívás”, érdemes odafigyelni.

A számok önmagukért beszélnek. Az AWS tavaly 3,8 gigawattnyi adatközponti kapacitást épített ki, és ezt néhány éven belül megduplázza. Közben félmillió GPU-t telepítettek egyetlen év alatt – és ugyanennyit terveznek a következőben is.

„Olyan adatközpontokról beszélünk, amelyek akár gigawattos skálára is képesek, nagyon kis területen” – fogalmaz Ruth Gratzke, a Siemens Smart Infrastructure U.S. elnöke.

A technológiai tempót jól mutatja, hogy a hűtési megoldások fejlesztési ciklusa is radikálisan lerövidült: „a tervezőasztaltól a működő rendszerig kevesebb mint 12 hónap telt el” – mondja Joern Tinnemeyer, az AWS adatközponti mérnöki területének alelnöke.

Ez nem egyszerű növekedés, hanem ipari léptékváltás

A beszélgetésben kirajzolódó kép ennél is mélyebb átalakulást jelez. Ruth Gratzke három, egymással párhuzamosan zajló változást emelt ki, amelyek alapjaiban formálják át az adatközpontok működését.

Az első a skála és az energiasűrűség drasztikus növekedése. Az új létesítményeknek úgy kell elérniük a gigawattos kapacitást, hogy közben a rendelkezésre álló fizikai tér nem nő arányosan. Ez nemcsak mérnöki, hanem infrastruktúra-szintű kihívás, amely az energiaelosztási modellek újragondolását is kikényszeríti.

A második a hűtés kérdése. A növekvő teljesítménysűrűség miatt a hagyományos léghűtés egyre kevésbé elegendő, így a folyadékhűtés válik meghatározóvá – nem alternatívaként, hanem szükségszerűségként.

„Egy gigawatt teljesítményt kell kinyernünk egy nagyon zárt ingatlanból, és ez sok hőt jelent egy zárt környezetből. És ezért kell látnunk az átállás igényét a léghűtésről a folyadékhűtésre – fogalmaz Gratzke.

A harmadik változás a terhelési profilok átalakulása. Míg a klasszikus felhőalapú rendszerek viszonylag stabil működést mutatnak, az AI-hoz kapcsolódó számítási feladatok viszont rendkívül ingadozóak. Az intenzív számítási fázisokat hirtelen leállások és adatcserék követik, ami a villamos hálózat számára szélsőségesen nehezen kezelhető helyzetet jelent.

„Mindegyik processzor fut, majd szüneteltetniük kell, hogy adatokat cseréljenek. Elektromos szempontból ez olyan terhelési profilt jelent, amely úgy néz ki, mintha egy rövidzárlatból nyitott kapcsolatokba kerülnénk, tehát nagyon szeszélyes, és ez a legrosszabb dolog, amit a hálózattal tehetünk” – emeli ki Gratzke.

Joern Tinnemeyer ehhez kapcsolódva arra hívta fel a figyelmet, hogy az infrastruktúra-fejlesztés tempója is új dimenzióba lépett. Az AWS példáján keresztül jól látszik, hogy a korábban években mérhető fejlesztési ciklusok hónapokra rövidültek, miközben a rackenkénti teljesítményigény a korábbi hagyományos adatközponti 10–12 kW-ról akár 120–140 kW-ra nőhet. Ez már nem egyszerű növekedés, sokkal inkább léptékváltás.

Mindkét vezető egyetért abban, hogy több dimenzióban kell optimalizálniuk a rendszert. Gratzke szerint ez már finomhangolás, ami már nem csak mérnöki munka, hűtés, csak számítástechnika. Vannak megújuló energiaforrásokkal kapcsolatos szempontok is, vagy üzemidő-megfontolások is.”

Kihívás a sebességkövetelmények megváltozása is, mint Gratzke fogalmaz: „a Siemens mérnökei hozzászoktak ahhoz, hogy évekig dolgoztak, amikor új termékeket dobtak piacra. Most, hogy ugyanezt hat hónap alatt kell megtennünk,teljesen újra kell gondolnunk a munkamódszereinket.”

Tinnemeyer kiemeli, hogy AI szoftvereket használnak annak optimalizálására, hogy pontosan hová kell kerülniük a szervereknek. Ez 12%-kal nagyobb teljesítmény- és számítási kapacitást biztosított számukra.

A szoftveralapú megközelítéssel Gratzke is egyetért: „nincs más út a digitális eszközkészletek nélkül. Szoftveralapúnak kell lennie, szimulációnak kell lennie, különböző tudományágak összefogására van szükség. Legyen szó akár a Simcenterről, akár a digitális ikertechnológiánkról, ott kezdődik minden. Ceruzával és papírral nem fogjuk ezt a kihívást a szükséges sebességgel megoldani.”

Mi a helyzet a fenntarthatósággal és az életciklus-kihívásokkal?

Gratzke ennek kapcsán egy olyan kritikus kérdést vet fel, amelyet az iparág nem teljesen válaszolt még meg: az adatközpontok átlagos élettartama mindössze nyolc év, de mi lesz utána?

Aztán mindent ki kell szedni és ki kell cserélni, mert az iparág technológiája olyan gyorsan fejlődik. Mit csinálnak ezzel a sok berendezéssel? Rengeteg nemesfém és ásványi anyag van benne, amelyeket vissza akarnak nyerni és kinyerni. A környezeti hatás figyelmet igényel.

Az AI-infrastruktúra ilyen sebességű kiépítéséhez újra kell gondolni a chipek anyagait, a hulladékhő-visszanyerő rendszereket, a hűtési hőmérsékleteket és az energiaforrásokat. A mesterséges intelligencia exponenciális növekedésével lépést tartani kell a zöld energiával.

A PUE utáni korszak: amikor már az számít, mit termel az energia

Hosszú ideig a PUE (Power Usage Effectiveness) volt az adatközpontok hatékonyságának alapmutatója. Minél közelebb volt az érték az 1,0-hoz, annál jobb. Az AI azonban új kérdést tesz fel: nem azt, hogy mennyire hatékony az infrastruktúra, hanem azt, hogy mit állít elő.

Így jelenik meg a tokens-per-watt fogalma – vagyis hogy egy watt energiából mennyi hasznos AI-output keletkezik, ami már nem technológiai mutató, hanem üzleti mérce.

Az adatközpont mint AI-gyár

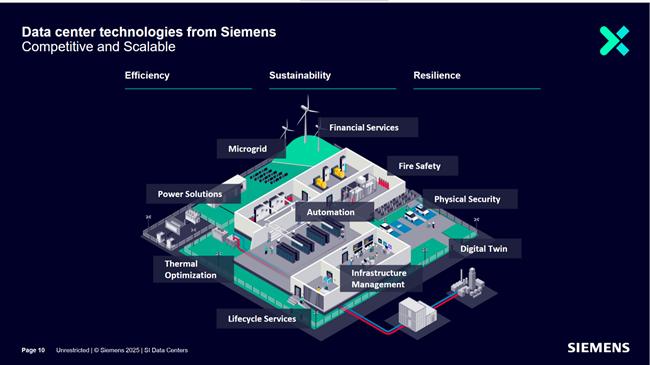

A Siemens szerint tehát az adatközpontok fejlődése egyszerre több dimenzióban gyorsul fel: a skála megawattról gigawattra nő, a teljesítménysűrűség többszörösére ugrik, a hűtési megoldások átalakulnak, miközben az innovációs ciklusok radikálisan lerövidülnek.

Ez vezet el az úgynevezett „AI factory” modellhez, amiben az adatközpont többé nem háttér-infrastruktúra, hanem értéket termelő üzem.

Kihívások az energiában, a hőelvezetésben és a komplexitásban

A növekedés ára jelentős: extrém energiaigény, hálózati korlátok, hőelvezetési problémák és egyre komplexebb rendszerek jelennek meg.

A legnagyobb kihívás azonban nem egy-egy területben rejlik, hanem abban, hogy ezeket egyszerre kell optimalizálni.

A Siemens rendszerszintű válasza az AI-korszakra

A Siemens erre a kihívásra nem izolált technológiákkal, hanem integrált megközelítéssel reagál. A cél az, hogy a számítási kapacitás, az energiaellátás és a hűtés ne külön rendszerekként működjenek, hanem egymással szorosan összekapcsolt egységként.

Ennek egyik kulcsa a digitális iker, amely lehetővé teszi az adatközpont működésének előzetes modellezését és folyamatos optimalizálását. Egy ilyen környezetben már a tervezés során szimulálható, hogyan reagál a rendszer különböző terhelésekre, majd az üzemeltetés során valós időben finomhangolható.

Erre épül az automatizáció, amely összekapcsolja a számítási az energiafelhasználás és a hűtés adatait. Az AI-adatközpontok esetében ugyanis nem elegendő az egyes alrendszerek külön optimalizálása: a teljes infrastruktúrát kell egy rendszerként kezelni

Az energia oldalán a hangsúly a skálázható, nagy teljesítményű infrastruktúrán van, amely képes kezelni a gigawattos igényeket és a gyorsan változó terhelési mintázatokat.

Ezzel párhuzamosan a hűtés is alapjaiban alakul át. A növekvő teljesítménysűrűség miatt a folyadékhűtés és a precíz termikus optimalizáció már nem opcionális, hanem a működés feltétele.

Mindezt egy nyílt ökoszisztéma egészíti ki, amelyben különböző technológiai partnerek együttműködése biztosítja, hogy a számítás, az energia és az infrastruktúra rugalmasan és gyorsan skálázható legyen.

Az új mérce a produktivitás

Az adatközpontok jövője nem az energiafogyasztás minimalizálásáról szól., hanem arról, hogy mennyi értéket lehet előállítani egységnyi energiából.

A kérdés tehát már nem az, hogy milyen a PUE, hanem az, hogy mennyi a tokens per watt.